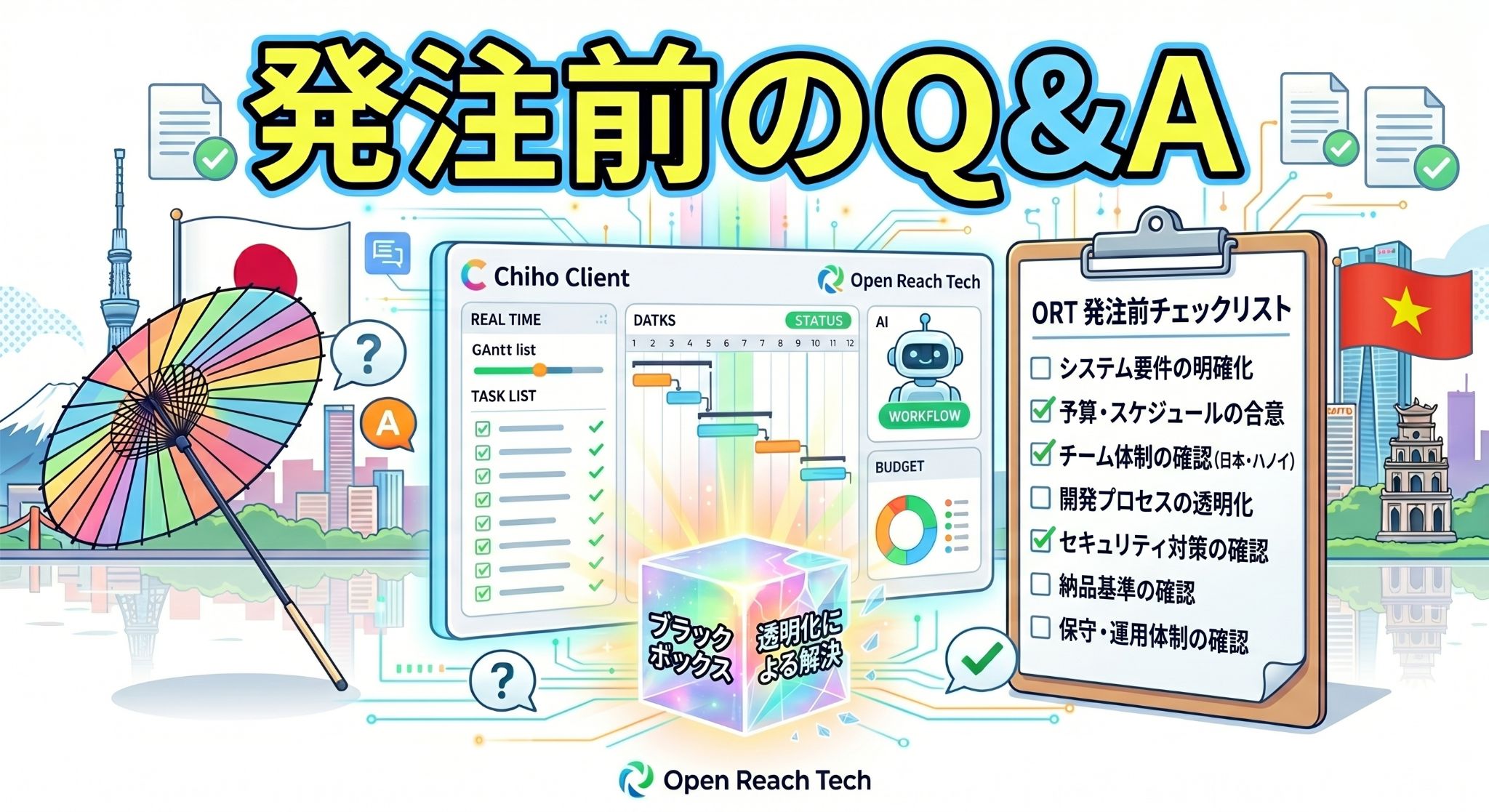

職場で働くAIエージェント:Chihoは部門知識をどのように自動化出力へ変換するか

社内のスペシャリストをエージェントとしてモデル化し、一貫性と説明可能性のある運用業務を提供するChihoの仕組みを技術的観点から解説。

概要

本記事では、ChihoがAIエージェントをオペレーションの単位として活用する方法を解説する。プロンプトベース利用が結果のばらつきを生みやすいのに対し、エージェントは役割・スコープ・タスクロジックで定義される。ワークフロー内で協働し、検証とログによって一貫性を保ち、部門知識を反復可能な出力へと変換する。

1. 企業に必要なのはAIチャットボットではなくAIスペシャリストである理由

多くの組織はチャットインターフェースでAIを試し、プロンプトを書いて要約やドラフト生成を依頼する。しかしこの手法には明確な限界がある。

- 結果の一貫性がない ユーザーごとにプロンプトが異なる。テンプレートがあっても、言い回しやモデル、文脈によって出力は変動する。

- 運用上の構造がない

チャットボットは以下を知らない:

- 誰がタスクの責任者か

- 何が「良い」出力か

- 今日の結果が先週の結果とどう関係すべきか

- 依頼の前後でどのステップが必要か

- 責任や追跡可能性がない チャットは、チーム全体でのレビューやデバッグに適した形でログを保存することがほとんどない。

なぜ専門化が重要か

信頼性を確保するには、AIに境界が必要だ。

- 「このタスクは何か?」

- 「どの知識を参照すべきか?」

- 「正しい出力を定義する基準は何か?」

Chihoのエージェントは、一般的なチャット応答者ではなく、役割ベースの仮想スペシャリストとして振る舞うことで、これらのギャップを埋める。

2. エージェントの構築方法

ChihoのAIエージェントは複数のコンポーネントで定義される。これらが振る舞いを制約し、異なるユーザーが同じプロセスを実行しても一貫した出力を生む。

(1) 役割定義

各エージェントには明確な機能がある。例:

- 会議要約担当

- タスク抽出担当

- 要件分析担当

- レポート整形担当

- 通知作成担当

単一の責務を持つチームメンバーのように、モデルに業務上のアイデンティティを与える。

(2) 知識スコープ

ChihoはもはやSpec Hubを機能名として位置付けてはいないが、エージェントは依然として構造化された内部情報に依存する。スコープには以下が含まれる:

- 関連ドキュメント

- 最近のディスカッション

- 過去の出力

- ツール経由で取得するシステムデータ

これにより無関係な情報への言及を防ぎ、一貫性が向上する。

(3) プロンプトアーキテクチャ

各エージェントには複数層の指示が埋め込まれている:

- 役割固有の指示

- タスクロジック(出力に期待されるステップ)

- フォーマット規則

- 検証基準

- エッジケース対応

行き当たりばったりのプロンプトを、安定した運用仕様に置き換える。

(4) モデル選択ロジック

ワークフローは、各ステップでエージェントがどのモデルを使うかを判断できる。

- 構造化推論にはGPT

- 長文コンテキスト分析にはClaude

- 特定の文章生成にはGemini

これにより、その段階のタスクに最適なモデルで実行できる。

3. エージェントの協働

多くの実務プロセスには、単一のジェネラリストではなく複数のスペシャリストが必要だ。Chihoはワークフロー内でのエージェント間協働としてこれをモデル化する。

出力の受け渡し

あるエージェントの出力が次のエージェントの入力になる。例:

- エージェントA → 会議要約

- エージェントB → タスク抽出

- エージェントC → Slack向け通知

各ステップは、人手での再整形や再解釈を必要とせずにデータを変換する。

タスクの責任範囲

各エージェントは一つの段階だけに責任を持つ。これにより以下を防ぐ:

- プロンプトのドリフト

- ステップ間の不整合

- 責任の混乱

一貫性の維持

エージェントが固定ロジックで定義されているため、ワークフローは次を生む:

- 同じ構造

- 同じ説明基準

- ばらつきの制御が予測可能

例:週次レポートのワークフロー

典型的なマルチエージェントの流れは次のように動作する:

- エージェントAがディスカッションデータを読み、構造化された会議要約を生成

- エージェントBが担当者と期限付きでタスクを抽出

- エージェントCが外部送信用のSlack通知を準備

- ツールレイヤーが結果を自動投稿

異なるユーザーから同じ依頼があっても、毎回同じ構造で出力される。

4. 信頼性対策

Chihoは、エージェントが予測可能に振る舞い、社内の期待に沿うよう複数の仕組みを組み込んでいる。

(1) 入力検証

出力を生成する前に、エージェントは以下を確認する:

- 必要なデータが存在するか

- 形式が有効か

- 主要フィールドが欠落していないか

無効な入力は、是正プロンプトやフォールバック動作を引き起こす。

(2) ログ

各ステップで記録される:

- プロンプト

- モデルのバージョン

- 入力の参照元

- 出力結果

- エラー

これはデバッグや、時間経過に伴うワークフローの挙動理解に不可欠だ。

(3) 過去の出力との比較

エージェントは過去の出力を参照でき、以下の継続性を保つ:

- 用語

- 構造

- 繰り返し登場するプロジェクトの詳細

これにより、文体や解釈が突然変化することを防ぐ。

(4) ハルシネーション防止

役割の制約、検証規則、制御されたツールアクセスによって、裏付けのない主張や憶測的な内容の生成を最小化する。エージェントは即興せず、定義されたタスク境界内で動作する。

結論

AIエージェントは、専門性をオペレーションとして具現化する構造的アプローチである。プロンプト作成やユーザー個々の習慣に依存するのではなく、Chihoは各エージェントを役割・知識スコープ・ロジックで定義する。これらをワークフローで組み合わせることで、透明なログと予測可能な挙動を備えた安定的で反復可能な出力を生み出す。この手法は、一貫性と説明可能性を同時に求められるプロセスにおいて自動化を実現し、従来のチャットボット的な利用では達成しにくい価値を提供する。